商业模式定制推动AI模型垂直应用

发布日期:2023-08-24 新闻来源:中国电影科技网

应用商城模式提供定制化AI模型交易平台

国内外研究团队联合推出六模态大语言模型PandaGPT

AI大模型集成框架LLM-Blender基于排序融合输出最优结果

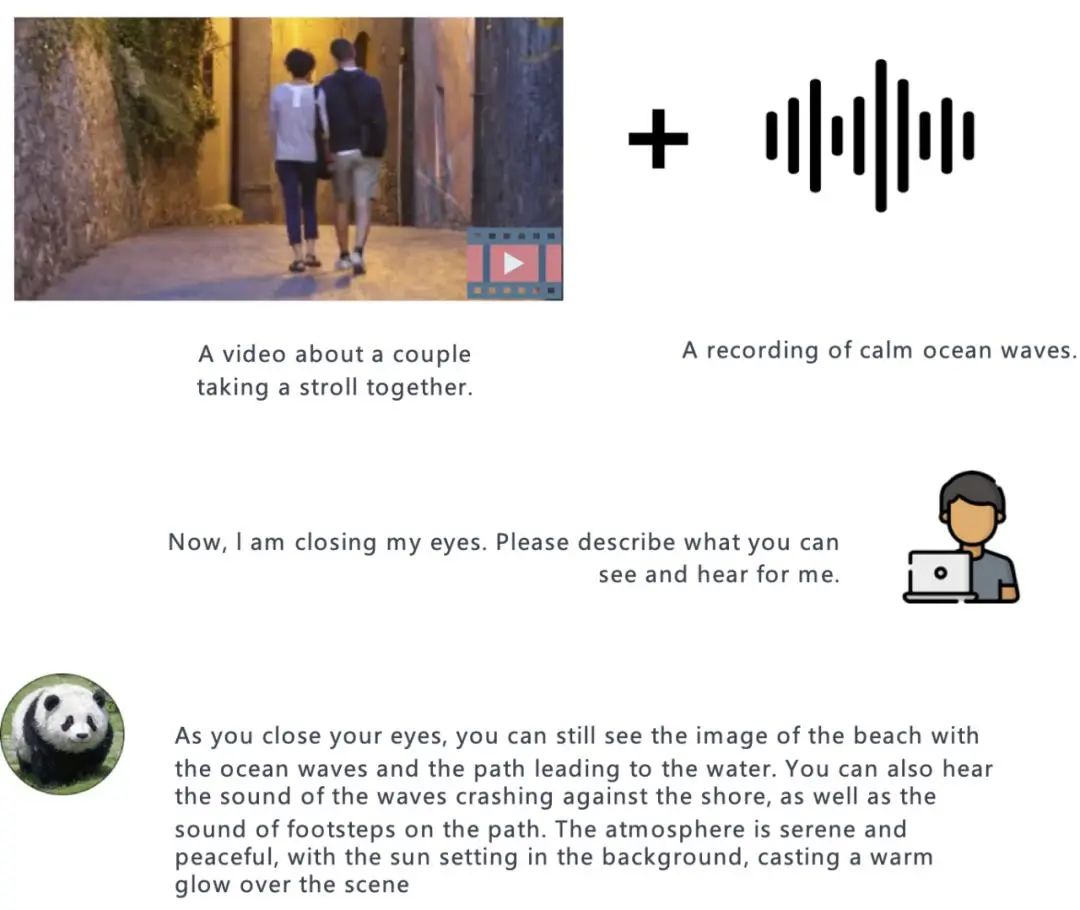

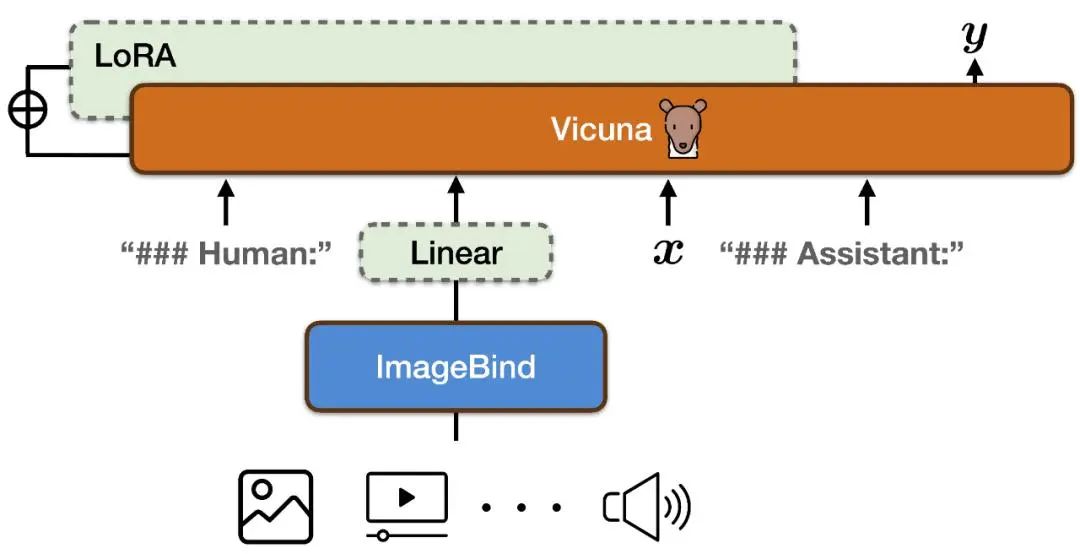

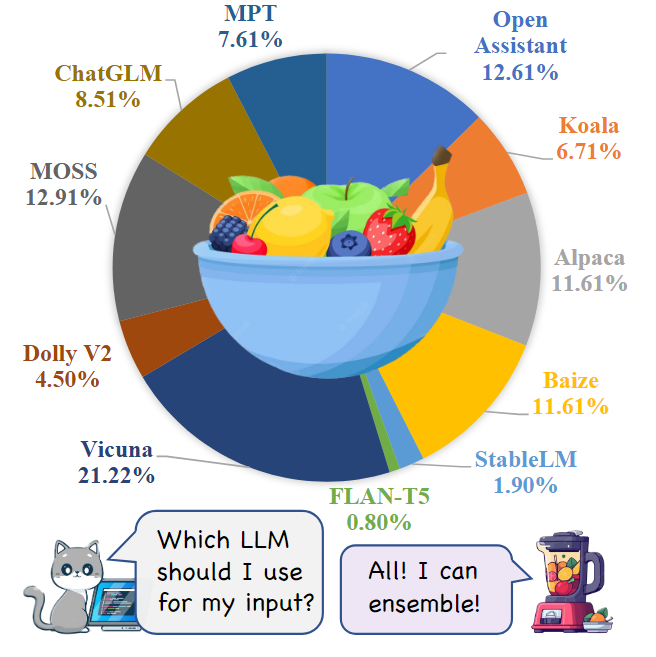

【点睛】 01 应用商城模式提供定制化AI模型交易平台 当前通用AI大语言模型在用户接入、训练、部署和应用时,往往面临着数据训练成本、数据安全、专业知识等挑战,为具体产业落地带来局限。对此,商业模式定制应运而生。 美国人工智能技术公司OpenAI计划推出一个针对定制化模型/软件的交易市场,类似于App Store应用商城,允许开发者向其他企业出售自己的人工智能定制化模型,为企业提供个性化的人工智能模型服务。 腾讯云也在近期公布了其MaaS(模型即服务,Model-as-a-Service)业务计划,依托腾讯云TI平台创建行业大模型精选商店,提供模型预训练、模型精调、智能应用开发等大模型解决方案。用户加入自己独有的场景数据,可快速生成专属模型;也可根据自身业务场景需求,定制不同参数、不同规格的模型服务。 对于垂直领域来说,用户的流程、需求以及对于数据的理解,能够提升AI大模型个性化、专业化服务能力,在专业业务中实现发展与应用。由大模型作为开发平台,让开发者进一步对接终端用户,细分模型工作能力,能够让用户更有效地应用AI技术,同时也为平台带来更多的商业机会。 02 国内外研究团队联合推出六模态大语言模型PandaGPT 目前多模态技术研究大多局限于单模态输入,或是文本与其他模态的组合输入,缺乏对多模态输入的整体性和互补性信息感知。 对此,来自剑桥大学、奈良先端科学技术大学院大学和腾讯AI Lab的研究人员近日联合推出并开源了通用指令遵循模型PandaGPT,是首个实现跨六种模态执行指令的语言模型,可理解包括图像/视频、文本、音频、深度、热量(红外辐射)和惯性测量单元(IMU)的模态信息。 ▲以视频+音频作为输入的示例 PandaGPT将大型语言模型与不同模态对齐、绑定,以实现跨模态指令跟随能力。其结合了ImageBind的模态对齐能力和Vicuna的语言生成能力,可同时接受多个模态输入,并自然组合不同模态的语义,可执行生成详细图像描述、根据视频编写故事、回答音频问题等复杂任务。 ▲将ImageBind的多模态编码器与Vicuna大型语言模型相结合 PandaGPT超越传统的单模态分析,扩展了下游应用场景,更贴近通用人工智能(AGI)的实现方式。AGI(Artificial General Intelligence)是指一种能够像人类一样具有广泛认知能力的通用人工智能技术,与弱人工智能只能解决特定问题不同,AGI能够处理各种不同的任务,并具有学习、推理、判断和自我改进等能力。 目前PandaGPT只是一个研究原型,尚不能直接用于实际应用。 03 AI大模型集成框架LLM-Blender基于排序融合输出最优结果 美国艾伦人工智能研究所(Allen Institute for AI, AI2)近日联合南加州大学和浙江大学发表研究论文,提出LLM-Blender大模型集成框架,集合多个开源大语言模型(LLM)的优势,比较不同LLM生成结果,通过排序和融合,输出最优结果。 实验表明,该方法不仅可以有效减轻单一LLM中的偏见错误和不确定性信息,其输出结果也优于单个效果最好的LLM。 ▲LLM-Blender集合11个开源大语言模型 LLM-Blender框架集成了MPT、Open Assistant、Koala、Alpaca、Baize、StableLM、FLAN-T5、Vicuna、Dolly V2、MOSS和ChatGLM共11个大模型,主要包含PairRanker和GenFuser两个模块,分别对应框架运行的两个阶段:排序(Rank)与融合(Fuse)。 排序阶段,LLM-Blender首先通过PairRanker对不同的LLMs回答进行成对比较,得到这些回答的排名。融合阶段,LLM-Blender选择排名后的前k(如k=3)个回答,将其与原指令一起打包送到GenFuser模块作为输入,再重新生成一个融合回答。 总的来说,LLM-Blender是一个简单的集成学习框架,提出了排序融合生成的新思路,适用于任何LLM和任务,未来还可进一步扩展至更多模型甚至非文本模式。不过研究团队表明,该集成框架在计算效率,以及排序模型相对于人类评估的准确度方面尚存在一定局限性。 (本期图片均来自互联网) 编辑撰写丨张雪 校对丨王薇娜 审核丨王萃 终审丨刘达