智能科学技术积极服务和有力支撑电影产业转型升级

发布日期:2022-02-18 新闻来源:中国电影科技网

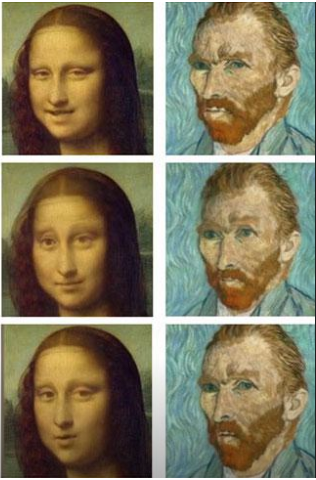

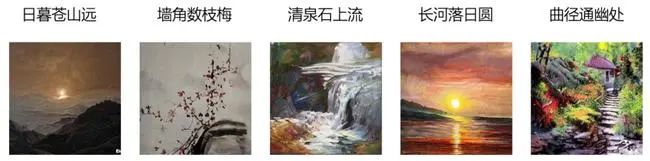

CES2022展示轻量级VR头显设备MeganeX MIT开源虚拟角色智能生成工具 百度文心跨模态生成模型实现智能图文双向生成 【点睛】 01 CES2022展示轻量级VR头显设备MeganeX 松下旗下科技公司Shiftall近日在国际消费电子产品展览会(CES2022)上展出了一款兼容SteamVR的6自由度VR头戴显示设备MeganeX。 ▲MeganeX 02 MIT开源虚拟角色智能生成工具 ▲为角色面部生成表情 03 百度文心跨模态生成模型实现智能图文双向生成 ▲文心ERNIE-ViLG古诗词生成图像 ▲文心ERNIE-ViLG图像生成文字 (本期图片均来自网络)