新一代游戏引擎:实现影视制作无缝虚实融合

发布日期:2022-02-18 新闻来源:中国电影科技网

《黑客帝国觉醒》演示片使用新一代游戏引擎实现无缝虚实融合

Autodesk与Epic联合推出Maya与UE专用连接插件

Assimilate推出Live FX软件服务虚拟摄制多元化应用需求

【点睛】

01

《黑客帝国觉醒》演示片使用新一代游戏引擎实现无缝虚实融合

为宣传即将上映的电影《黑客帝国4:矩阵重启》,华纳兄弟与Epic Games联合发布《黑客帝国觉醒:UE5体验》游戏演示片(Demo)为电影预热。

该演示片是电影制作团队与Epic合作使用UE5游戏引擎制作的游戏Demo,玩家可在Demo里身临其境地体验《黑客帝国》电影的画面场景和任务操作。

游戏Demo以影片场景开始,由数字角色带领进入交互游戏体验,包括汽车追逐和射击活动等。UE5的逼真仿真能力实现了一种全新的通过仿真进行电影制作的过程。该演示中,除了男女主角多重复制和城市全景两个镜头是预先渲染完成以外,其他画面均由UE5实时渲染呈现。

UE5的新功能包括Nanite虚拟微多边形几何体、Lumen动态全局光照方案在该Demo中都有应用。

Nanite:该Demo中的城市有700万个实例化资产,每个资产由数百万个多边形组成,UE5的Nanite系统,能够智能流送和处理其中百万个多边形,以负担如此高的模型承载量。

Lumen:UE5的动态全局照明系统Lumen利用实时光线追踪,在Demo的整个交互部分提供了逼真照明和反射,同时也用于实现电影质感,负责生成角色真实且柔和的阴影。

除上述技术,Demo中的追车场景使用了UE4.23版发布的Chaos物理系统进行破坏模拟,除内置的破碎功能之外,还具有动态应变损耗评估(Strain Evaluation)和碰撞功能,由于是实时模拟,每一次模拟均会产生不同的碰撞、爆炸和破碎效果。

Demo中的群集角色和车辆均由AI系统驱动生成。

片中主角的数字替身由Epic的3Lateral团队完成,首先对演员进行3D扫描,其后进行4D表演捕捉。团队使用移动4D扫描仪和7对立体相机搭建了一个交叉极化(Cross-Polarized)扫描阵列,配合使用Epic自有的HMC II绑定技术和基于姿势的解算器,实现人物更精准的动作捕捉。

可以预见,随着交互式叙事的逼真度达到一个全新阶段,游戏和电影的边界将愈加模糊,进而实现影视制作的无缝虚实融合。

02

Autodesk与Epic联合推出Maya与UE专用连接插件

Autodesk与Epic Games近日联合发布了用于Maya的官方插件Unreal Live Link for Autodesk Maya v1.0版本,可将虚幻引擎(UE)连接到动画制作软件Maya,制作人员可直接在Maya中操作,在Maya中控制一个骨架网格体动画,同时在UE中预览。目前该插件可在Maya2018到Maya2022中使用。

在联合使用Maya和UE进行动画场景制作时,通常需要制作Maya和UE两套绑定资产,且UE仅支持骨骼蒙皮和融合变形,遇到复杂的绑定,将Maya资产转化为UE资产是一项十分庞杂的工程。

为此,行业已推出相关工具。此前用于这一场景的工具有通用Live Link、国产第三方插件Mirror和MUTools。

通用Live Link面向Maya和MotionBuilder,以UE为主为Maya提供适配接口。此次发布的插件Unreal LiveLink是专用于UE和Maya之间的连接,是Autodesk与Epic Games在原有基础上联合进行的一系列优化升级,包括优化用户体验和工作流,支持BlendShapes,制作人员可调整角色的面部表情实现唇音同步,并实时表现在虚幻引擎中;支持变换、视场角、焦距、相机光圈、宽高比、景深、焦距等摄影机属性;支持颜色、强度、圆锥角、半影角等照明调节;场景的时间码可作为元数据被传输至UE,实现Maya和UE之间的同步播放。

插件基本工作流程为:在Maya中创作内容,其后将骨架网格体导出到UE中,通过在UE中设置建立一个连接,即可在UE Live Link主题上预览在Maya中创作的动画。在连接设置方面,此次发布的Unreal Live Link for Autodesk Maya相较此前的通用Live Link更为简易。

03

Assimilate推出Live FX软件服务虚拟摄制多元化应用需求

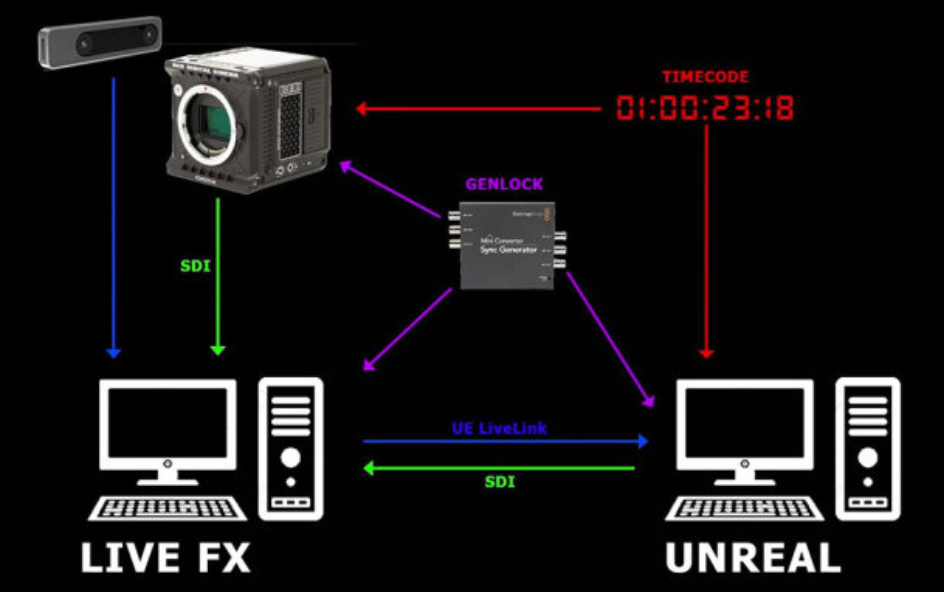

近日,美国软件公司Assimilate推出Live FX软件测试版,可用于实现多种虚拟制作工作流的实时合成,包括片场绿幕与LED显示墙虚拟制作的实时合成和虚拟勘景等,拥有抠图、摄影机跟踪、DMX灯光控制等技术,可实时连接虚幻引擎(UE),是现有虚拟摄制现场多种码流合成的一站式软件解决方案。

摄影机跟踪

绿幕抠像与LED显示

Live FX具备多样抠像算法,可使用层堆栈创建并结合多个抠像图层,也可将多个遮罩加入合成中。

Live FX支持对素材回放进行色彩管理,不限素材分辨率与帧率,可直接从UE中将3D场景显示至LED屏上。当内容加载好后,可对其进行调色、构图调整等操作。

灯光控制

根据投影的图像内容实时自动控制灯光。拍摄团队可通过DMX灯光控制引擎在LED屏显示的素材上标记选定区域,由Live FX分析并算出标记区域内每一帧的平均色彩,并将色彩发送至虚拟制作录影棚的灯光控制。

同步管理

记录完整元数据用于离线后期制作

H264、Avid DNx、Apple ProRes等码流传入Live FX都会被录制下来,并可即时回放审阅。在多个实时信号的环境中,摄制人员可选择录制最终效果或分别录制单个原始输入信号,同时所有采集并用于实时合成的元数据都会被保存到文件中。

实际拍摄中,可先进行实时合成,再分别录制原始输入内容与元数据,录制完成后,Live FX将自动创建离线合成,并即刻回放并审阅。离线合成是对实时合成的备份,并不使用实时信号而是使用录制文件,离线合成包含所有其他元素和动画通道,可用于后期特效制作。

(本期图片均来自网络)